Kluczowe informacje o Server-Side Request Forgery (SSRF)

- SSRF to podatność, która pozwala atakującemu zmusić serwer do wykonania nieautoryzowanych żądań sieciowych

- Została sklasyfikowana jako A10:2021 w prestiżowym rankingu OWASP Top 10 ze względu na rosnące ryzyko

- Umożliwia skanowanie sieci wewnętrznej, dostęp do usług na localhost oraz kradzież krytycznych metadanych z platform chmurowych (np. AWS)

- Ataki SSRF mogą wykorzystywać różnorodne protokoły, w tym `http://`, `file:///`, `gopher://` czy `dict://`

- Wyróżnia się Basic SSRF (z widoczną odpowiedzią) oraz Blind SSRF (z ukrytą odpowiedzią, wymagającą pośrednich metod detekcji)

- Skuteczna obrona opiera się na głębokiej walidacji danych wejściowych, stosowaniu list dozwolonych oraz restrykcyjnej konfiguracji sieciowej

Dlaczego SSRF awansowało do pierwszej dziesiątki zagrożeń OWASP?

Pozycja SSRF w rankingu OWASP Top 10 jako A10:2021 jest bezpośrednim odzwierciedleniem jego rosnącej grozy w nowoczesnych architekturach. Kiedyś ataki te były postrzegane jako bardziej niszowe, dziś stanowią kluczowe zagrożenie, ponieważ wykorzystują samą naturę komunikacji między komponentami systemów. Atakujący wykorzystuje zaufanie, jakim obdarza się serwer wewnątrz sieci, by zmusić go do wykonania żądań, które normalnie byłyby zablokowane przez zewnętrzne zabezpieczenia. W erze rozproszonych systemów, mikroserwisów i wszechobecnej chmury, gdzie serwery nieustannie wymieniają między sobą dane, takie podatności stają się bramą do infiltracji.

SSRF: Czym dokładnie jest i dlaczego serwer staje się Twoim wrogiem?

Server-Side Request Forgery (SSRF) to podatność w aplikacjach webowych, która pozwala atakującemu zmusić serwer do wykonania żądań sieciowych do nieprzewidzianej lokalizacji w jego imieniu. Dzieje się tak, gdy aplikacja pobiera zasób ze zdalnej lokalizacji na podstawie adresu URL dostarczonego przez użytkownika, bez odpowiedniej walidacji tego adresu. W praktyce oznacza to, że serwer, który powinien być zaufanym elementem Twojej infrastruktury, staje się narzędziem w rękach atakującego, wykonującym jego polecenia i komunikującym się z zasobami, do których normalnie nie powinien mieć dostępu.

Od teorii do praktyki: Jak atakujący wykorzystuje serwer jako zaufane proxy?

Mechanizm działania SSRF polega na wykorzystaniu serwera jako swoistego "zaufanego proxy". Atakujący, zamiast próbować bezpośrednio połączyć się z wewnętrznym zasobem, który jest chroniony przez firewall lub znajduje się w niedostępnej sieci, wysyła żądanie do podatnej aplikacji webowej. Ta aplikacja, niepoprawnie walidując otrzymany URL, wykonuje żądanie w imieniu atakującego. Ponieważ żądanie wychodzi z serwera, który posiada zaufanie w sieci wewnętrznej, może ono dotrzeć do celu, który byłby niedostępny z zewnątrz. W ten sposób serwer staje się pośrednikiem w komunikacji, otwierając drogę do skanowania sieci, dostępu do danych konfiguracyjnych czy nawet przejmowania kontroli nad systemami.

Krótka historia podatności, która stała się kluczowym zagrożeniem w erze chmury

Podatność SSRF nie jest nowym odkryciem, ale jej znaczenie drastycznie wzrosło wraz z rozwojem nowoczesnych architektur IT. Kiedyś aplikacje były często monolityczne, a komunikacja sieciowa była bardziej ograniczona. Dziś, w świecie mikroserwisów, kontenerów i wszechobecnej infrastruktury chmurowej, serwery komunikują się ze sobą na niespotykaną dotąd skalę. Każde takie połączenie, jeśli nie jest odpowiednio zabezpieczone, staje się potencjalnym wektorem ataku SSRF. Dostawcy chmury, tacy jak AWS, Azure czy Google Cloud, oferują bogate API i usługi metadanych dostępne przez wewnętrzne punkty końcowe, które są niezwykle atrakcyjnym celem dla atakujących wykorzystujących SSRF.

Anatomia ataku SSRF: Jak to działa krok po kroku?

Ataki SSRF mogą przybierać różne formy, a ich potencjalne konsekwencje są dalekosiężne. Zrozumienie konkretnych scenariuszy pozwala lepiej docenić skalę zagrożenia i podjąć odpowiednie kroki zaradcze. Przyjrzyjmy się bliżej kilku typowym przykładom, które ilustrują, jak atakujący mogą wykorzystać tę podatność.

Scenariusz #1: Atak na samego siebie – skanowanie usług na `localhost`

Jednym z najprostszych, a jednocześnie niebezpiecznych zastosowań SSRF jest skanowanie usług działających na serwerze lokalnym, czyli `localhost` (127.0.0.1). Wiele aplikacji, baz danych czy narzędzi administracyjnych nasłuchuje tylko na tym adresie, zakładając, że są one chronione przez fakt bycia dostępnymi wyłącznie z poziomu samego serwera. Atakujący, wykorzystując podatność SSRF, może wysłać żądanie do takich usług, np. do panelu administracyjnego bazy danych, API diagnostycznego czy nawet serwera SSH, jeśli nie jest poprawnie skonfigurowany. To pozwala na odkrycie wrażliwych punktów dostępu, które normalnie byłyby niewidoczne z zewnątrz.

Scenariusz #2: Mapowanie fortecy od środka – skanowanie sieci wewnętrznej i portów

SSRF jest doskonałym narzędziem do mapowania wewnętrznej topologii sieci. Atakujący może użyć podatnego serwera jako punktu wyjścia do skanowania innych hostów w sieci wewnętrznej oraz otwartych na nich portów. Wyobraźmy sobie, że serwer aplikacji ma dostęp do serwerów baz danych, serwerów plików czy innych usług w sieci lokalnej. Atakujący, poprzez SSRF, może wysyłać żądania do tych wewnętrznych adresów IP i portów. W ten sposób może odkryć, jakie usługi są uruchomione, jakie mają wersje, a nawet czy są podatne na inne ataki. Jest to szczególnie groźne, ponieważ pozwala ominąć firewalle, które chronią sieć od zewnątrz, ale mogą być mniej restrykcyjne w ruchu wewnętrznym.

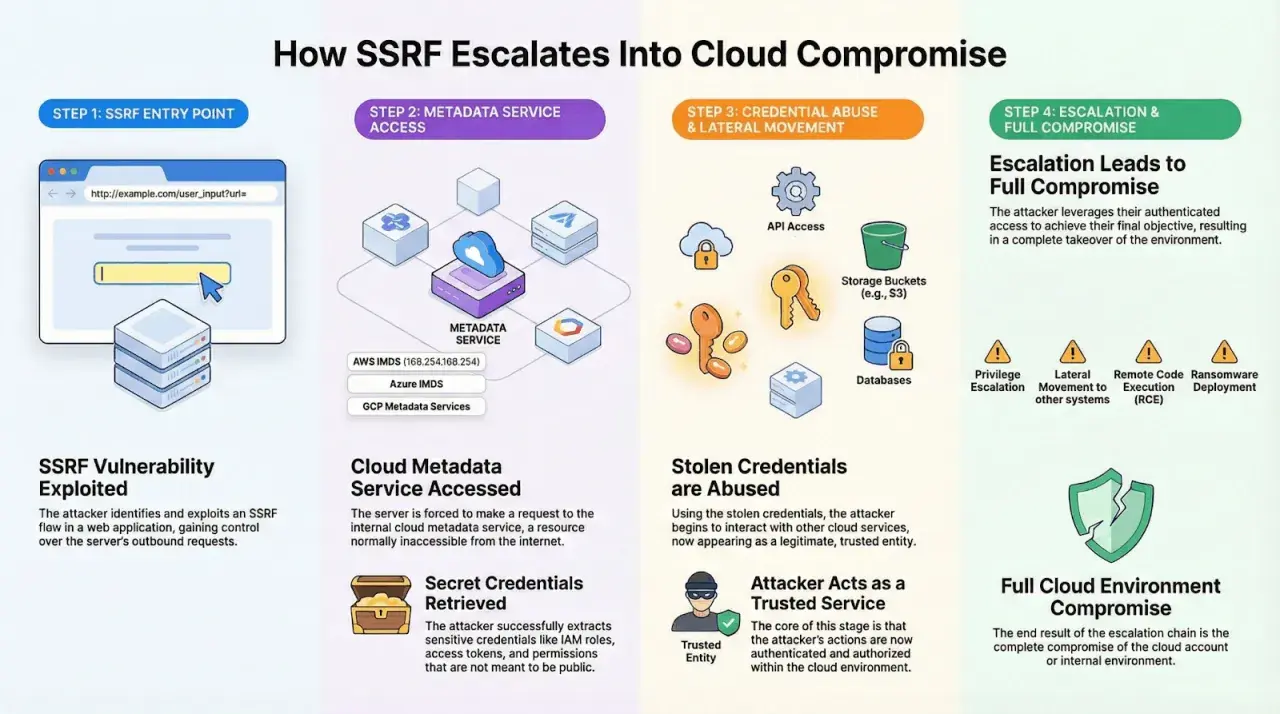

Scenariusz #3: Kradzież „klejnotów koronnych” w chmurze – jak wykraść metadane z AWS, GCP i Azure

Współczesne aplikacje często działają w infrastrukturach chmurowych. Dostawcy chmury udostępniają specjalne, wewnętrzne punkty końcowe (tzw. IMDS Instance Metadata Service), które pozwalają instancjom na pobranie informacji o sobie, w tym tymczasowych poświadczeń dostępu do usług chmurowych (np. tokenów IAM). W AWS, ten punkt końcowy to zazwyczaj `http://169.254.169.254`. Atak SSRF skierowany na ten adres może pozwolić atakującemu na kradzież tych poświadczeń. Posiadając takie tokeny, atakujący może uzyskać dostęp do praktycznie wszystkich zasobów w chmurze, co jest równoznaczne z pełnym przejęciem kontroli nad infrastrukturą. To jeden z najpoważniejszych skutków SSRF, który może prowadzić do katastrofalnych strat finansowych i reputacyjnych.

Nie tylko HTTP: Jak atakujący wykorzystują schematy `file:///`, `gopher://` i `dict://`?

Choć najczęściej mówi się o atakach SSRF wykorzystujących protokoły `http://` i `https://`, atakujący mogą sięgać po inne, mniej oczywiste schematy URL. Schemat `file:///` pozwala na odczyt lokalnych plików z systemu plików serwera. Atakujący może próbować odczytać pliki konfiguracyjne, klucze prywatne czy inne wrażliwe dane. Protokół `gopher://` jest niezwykle potężny, ponieważ pozwala na tworzenie surowych zapytań do dowolnych usług sieciowych, nie tylko HTTP. Można go użyć do interakcji z bazami danych, serwerami pocztowymi czy innymi usługami nasłuchującymi na określonych portach. Z kolei `dict://` może być wykorzystywany do uzyskiwania informacji o usługach, np. poprzez wysyłanie komend do serwerów Redis.

Rodzaje podatności SSRF: Co musisz wiedzieć, by skutecznie je wykryć?

Rozróżnienie między różnymi typami podatności SSRF jest kluczowe dla skutecznego ich wykrywania i reagowania. Chociaż podstawowy mechanizm jest podobny serwer wykonuje żądanie w imieniu atakującego sposób, w jaki atakujący otrzymuje informacje zwrotne, znacząco wpływa na trudność ataku i metody detekcji.

Basic SSRF: Kiedy serwer "gada" za dużo

W przypadku Basic SSRF, aplikacja zwraca atakującemu bezpośrednią odpowiedź z wykonanego żądania. Jeśli atakujący wysłał żądanie do wewnętrznego adresu IP, a serwer zwrócił jego zawartość (np. kod HTML strony, odpowiedź API), atakujący od razu wie, że atak się powiódł i może analizować uzyskane dane. Ten typ podatności jest zazwyczaj łatwiejszy do zidentyfikowania i eksploatacji, ponieważ skutki żądania są widoczne w odpowiedzi serwera. Deweloperzy mogą zauważyć nietypowe dane w odpowiedziach aplikacji, które nie powinny się tam pojawić.

Blind SSRF: Jak znaleźć lukę, gdy nie widać odpowiedzi?

Blind SSRF jest znacznie trudniejszy do wykrycia i eksploatacji, ponieważ aplikacja nie zwraca bezpośredniej odpowiedzi z wykonanego żądania do atakującego. Atakujący wysyła żądanie, ale w odpowiedzi widzi tylko standardowy komunikat lub nic. Jednak nawet w takim przypadku istnieją sposoby na potwierdzenie podatności i wydobycie danych. Atakujący może wykorzystać techniki pośrednie. Jedną z nich jest mierzenie czasu odpowiedzi serwera jeśli żądanie do wewnętrznego zasobu trwa dłużej, może to sugerować, że zostało ono przetworzone. Inną, bardzo skuteczną metodą jest wykorzystanie zewnętrznych serwerów kontrolowanych przez atakującego, np. za pomocą narzędzi takich jak Burp Collaborator. Aplikacja, wykonując żądanie SSRF, może nawiązać połączenie z takim zewnętrznym serwerem, co atakujący może zaobserwować. To pozwala na potwierdzenie istnienia podatności i nawet na wydobywanie danych w sposób pośredni, poprzez analizę logów lub błędów komunikacji.

Jak zbudować mur obronny przed SSRF? Kluczowe strategie prewencyjne

Skuteczna obrona przed SSRF wymaga wielowarstwowego podejścia, znanego jako "defense in depth". Nie wystarczy zabezpieczyć tylko jedną warstwę należy zaimplementować mechanizmy obronne zarówno na poziomie aplikacji, jak i infrastruktury sieciowej. Tylko takie kompleksowe podejście może zapewnić wysoki poziom bezpieczeństwa.

Warstwa aplikacji: Zabezpieczenia, które musisz wdrożyć w kodzie

Najlepszą linią obrony przed SSRF jest implementacja odpowiednich zabezpieczeń bezpośrednio w kodzie aplikacji. To tutaj decydujemy, jak aplikacja przetwarza dane wejściowe i jakie żądania może wykonywać.

Nigdy nie ufaj danym wejściowym: Rola i techniki solidnej walidacji URL

Fundamentalną zasadą bezpieczeństwa jest nigdy nie ufać danym pochodzącym od użytkownika. W kontekście SSRF oznacza to, że każdy adres URL podany przez użytkownika musi być dokładnie walidowany po stronie serwera. Proces ten powinien obejmować parsowanie URL, sprawdzenie schematu (czy jest to dozwolony protokół, np. `http` lub `https`), weryfikację hosta (czy jest to dozwolona domena lub adres IP) oraz portu. Walidacja musi być restrykcyjna i uwzględniać wszelkie potencjalne próby obejścia, takie jak użycie alternatywnych reprezentacji adresów IP (np. szesnastkowe, ósemkowe) czy kodowanie URL.

Lista dozwolonych (Allow-list) zamiast listy zablokowanych (Deny-list): Jedyna słuszna droga

W walce z SSRF, stosowanie listy dozwolonych (allow-list) jest zdecydowanie bezpieczniejszym podejściem niż lista zablokowanych (deny-list). Lista zablokowanych próbuje przewidzieć wszystkie możliwe złośliwe adresy URL i je blokuje. Jest to jednak zadanie niemal niemożliwe, ponieważ atakujący zawsze znajdą nowe sposoby na obejście takich list (np. przez nowe schematy, nietypowe formaty adresów IP). Lista dozwolonych natomiast definiuje ściśle, z jakimi zasobami aplikacja może się komunikować zezwala tylko na połączenia do predefiniowanych, zaufanych domen lub adresów IP. Wszystko inne jest domyślnie blokowane. To znacznie prostsze i skuteczniejsze podejście.

Blokowanie niebezpiecznych przekierowań HTTP

Przekierowania HTTP mogą stanowić dodatkowe ryzyko w kontekście SSRF. Atakujący może najpierw skierować żądanie do zaufanej domeny, która następnie przekieruje je do złośliwego zasobu, potencjalnie omijając wstępną walidację URL. Dlatego aplikacja powinna zawsze weryfikować docelowy adres URL po każdym przekierowaniu lub, co jest bezpieczniejszym podejściem, całkowicie blokować automatyczne przekierowania dla żądań inicjowanych przez użytkownika, jeśli nie są one absolutnie niezbędne.

Zarządzanie odpowiedziami: Dlaczego nigdy nie powinieneś zwracać surowej odpowiedzi serwera?

Bezpośrednie zwracanie surowej odpowiedzi z zewnętrznego serwera do użytkownika jest bardzo ryzykowną praktyką. Taka odpowiedź może zawierać wrażliwe informacje, takie jak nagłówki HTTP, dane konfiguracyjne, a nawet fragmenty kodu źródłowego, które mogą pomóc atakującemu w dalszej eksploatacji. Aplikacja powinna zawsze przetwarzać i filtrować otrzymane odpowiedzi, prezentując użytkownikowi tylko niezbędne i bezpieczne dane. Pozwala to również na ukrycie szczegółów technicznych, które mogłyby ujawnić istnienie podatności.

Warstwa sieci: Konfiguracja infrastruktury jako ostatnia linia obrony

Nawet najlepiej zabezpieczona aplikacja może paść ofiarą ataku, jeśli infrastruktura sieciowa nie zapewnia dodatkowych warstw ochrony. Konfiguracja sieci jest kluczowa dla ograniczenia potencjalnych szkód.

Siła segmentacji: Izolowanie funkcji o podwyższonym ryzyku

Segmentacja sieci polega na podziale infrastruktury na mniejsze, izolowane od siebie podsieci. Funkcje aplikacji, które wykonują żądania do zasobów zewnętrznych lub wewnętrznych, powinny być umieszczone w oddzielnych segmentach sieci z ograniczonym dostępem. Oznacza to, że serwer aplikacji, nawet jeśli zostanie skompromitowany przez SSRF, będzie miał bardzo ograniczony dostęp do innych części sieci. Segmentacja znacząco ogranicza zasięg potencjalnego ataku i minimalizuje ryzyko eskalacji kompromitacji.

Konfiguracja firewalla: Reguły "deny-by-default" dla ruchu wychodzącego

Restrykcyjna konfiguracja firewalla jest absolutnie kluczowa. Należy stosować zasadę "deny-by-default" dla ruchu wychodzącego z serwerów aplikacji. Oznacza to, że domyślnie wszystkie połączenia wychodzące są blokowane, a zezwolenie jest udzielane tylko na te połączenia, które są ściśle niezbędne do działania aplikacji. Należy zezwolić na komunikację tylko do konkretnych, zaufanych adresów IP i portów. Szczególnie ważne jest blokowanie prób połączeń do znanych adresów IP metadanych chmurowych (np. 169.254.169.254) oraz do adresów z puli prywatnych, jeśli nie są one potrzebne.

Jak sprawdzić, czy Twoja aplikacja jest podatna na SSRF?

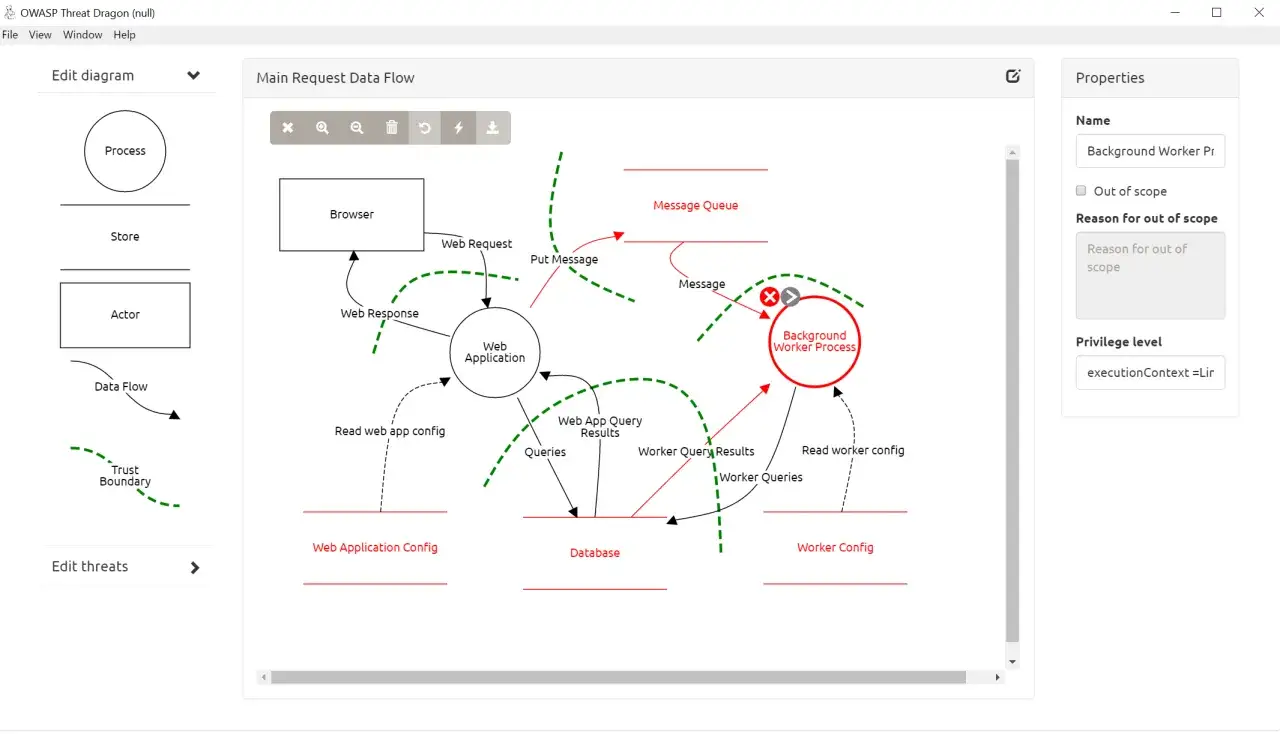

Regularne testowanie bezpieczeństwa aplikacji jest niezbędne do wykrywania i eliminowania podatności, w tym SSRF. Istnieje szereg narzędzi i technik, które mogą pomóc w identyfikacji luk, zarówno w fazie rozwoju, jak i podczas audytów bezpieczeństwa.

Praktyczne narzędzia i techniki do testowania podatności SSRF

Do testowania aplikacji pod kątem SSRF można wykorzystać wiele narzędzi. Proxy przechwytujące ruch, takie jak Burp Suite Professional czy OWASP ZAP, są nieocenione. Pozwalają one na przechwytywanie, analizowanie i modyfikowanie żądań HTTP wysyłanych przez aplikację. Tester może ręcznie modyfikować parametry URL, próbując wysyłać żądania do wewnętrznych adresów IP, adresów localhost, czy też używać różnych schematów protokołów. Istnieją również automatyczne skanery podatności, które potrafią wykrywać niektóre typy SSRF, jednak często wymagają one ręcznej weryfikacji i dostosowania do specyfiki aplikacji.Wykorzystanie zewnętrznych usług (np. Burp Collaborator) do wykrywania ataków typu Blind SSRF

Wykrywanie Blind SSRF stanowi szczególne wyzwanie, ponieważ brak bezpośredniej odpowiedzi utrudnia identyfikację podatności. Tutaj z pomocą przychodzą zewnętrzne usługi, takie jak Burp Collaborator. Działa to w następujący sposób: tester generuje unikalny adres URL lub domenę w usłudze Collaborator, a następnie próbuje zmusić podatną aplikację do wysłania żądania na ten adres. Jeśli aplikacja jest podatna na Blind SSRF, nawiąże połączenie z serwerem Collaborator. Usługa ta natychmiast powiadamia testera o przychodzącym połączeniu, wraz ze szczegółami (np. adres IP serwera aplikacji, nagłówki żądania). To pozwala na jednoznaczne potwierdzenie istnienia podatności, nawet jeśli żadne dane nie zostały zwrócone bezpośrednio do przeglądarki.

SSRF w świecie rzeczywistym: Analiza głośnych incydentów

Historia bezpieczeństwa IT zna wiele przypadków, w których podatności SSRF doprowadziły do poważnych incydentów. Analiza tych zdarzeń dostarcza cennych lekcji i podkreśla, jak ważne jest odpowiednie zabezpieczenie aplikacji przed tym zagrożeniem.

Studium przypadku: Jak prosta podatność doprowadziła do ogromnego wycieku danych?

Wyobraźmy sobie scenariusz, w którym aplikacja webowa odpowiedzialna za pobieranie zasobów z zewnętrznych URL (np. w celu generowania podglądów stron internetowych) jest podatna na SSRF. Atakujący wykorzystuje tę podatność, aby zmusić serwer do wysłania żądania do wewnętrznego punktu końcowego metadanych chmurowych. Dzięki temu udaje mu się wykraść tymczasowe poświadczenia dostępu do konta w chmurze. Posiadając te poświadczenia, atakujący uzyskuje pełny dostęp do bazy danych zawierającej wrażliwe dane klientów, a także do innych krytycznych zasobów. W efekcie dochodzi do ogromnego wycieku danych, który skutkuje nie tylko stratami finansowymi związanymi z naprawą szkód i karami, ale także z trwałym uszczerbkiem na reputacji firmy. To pokazuje, jak pozornie niewielka luka może otworzyć drzwi do katastrofalnych konsekwencji.

Przeczytaj również: Co to trackery internetowe - jak działają i chroń prywatność

Lekcje z ataków: Czego możemy się nauczyć z błędów innych?

Analiza rzeczywistych incydentów związanych z SSRF dostarcza kilku kluczowych lekcji. Po pierwsze, nigdy nie można lekceważyć walidacji danych wejściowych. Każdy URL podany przez użytkownika musi być traktowany z najwyższą podejrzliwością i dokładnie sprawdzany. Po drugie, strategia "defense in depth" jest kluczowa połączenie zabezpieczeń na poziomie aplikacji i sieci jest znacznie skuteczniejsze niż poleganie na jednym rozwiązaniu. Po trzecie, regularne testowanie bezpieczeństwa, w tym testy penetracyjne i audyty kodu, jest niezbędne do wykrywania podatności, zanim zostaną one wykorzystane przez atakujących. Wreszcie, świadomość zagrożeń wśród deweloperów i administratorów systemów jest fundamentem bezpiecznego tworzenia i utrzymywania aplikacji.